Análisis What-If y Comparación de Modelos

Dos módulos potentes en un espacio de trabajo. El Análisis What-If te permite explorar el comportamiento del modelo interactivamente. La Comparación de Modelos proporciona un espacio de diagnóstico de 20 pestañas con SHAP, PDP, curvas ROC, métricas de equidad y más en todos tus modelos.

Key Capabilities

Everything you need to get the most out of this module.

Escenarios What-If

Compara escenarios base vs modificados lado a lado. Ve exactamente cómo los cambios afectan las predicciones con explicaciones SHAP.

Comparación de Modelos

Espacio de diagnóstico completo con 20 pestañas de análisis en 6 categorías. Compara hasta 10+ modelos simultáneamente.

Suite de Explicabilidad

Análisis SHAP, explicaciones LIME, importancia de variables, gráficos de dependencia parcial e interacciones de features.

Analítica Avanzada

Curvas ROC, matrices de confusión, gráficos de calibración, curvas de aprendizaje, métricas de equidad y constructor de ensembles.

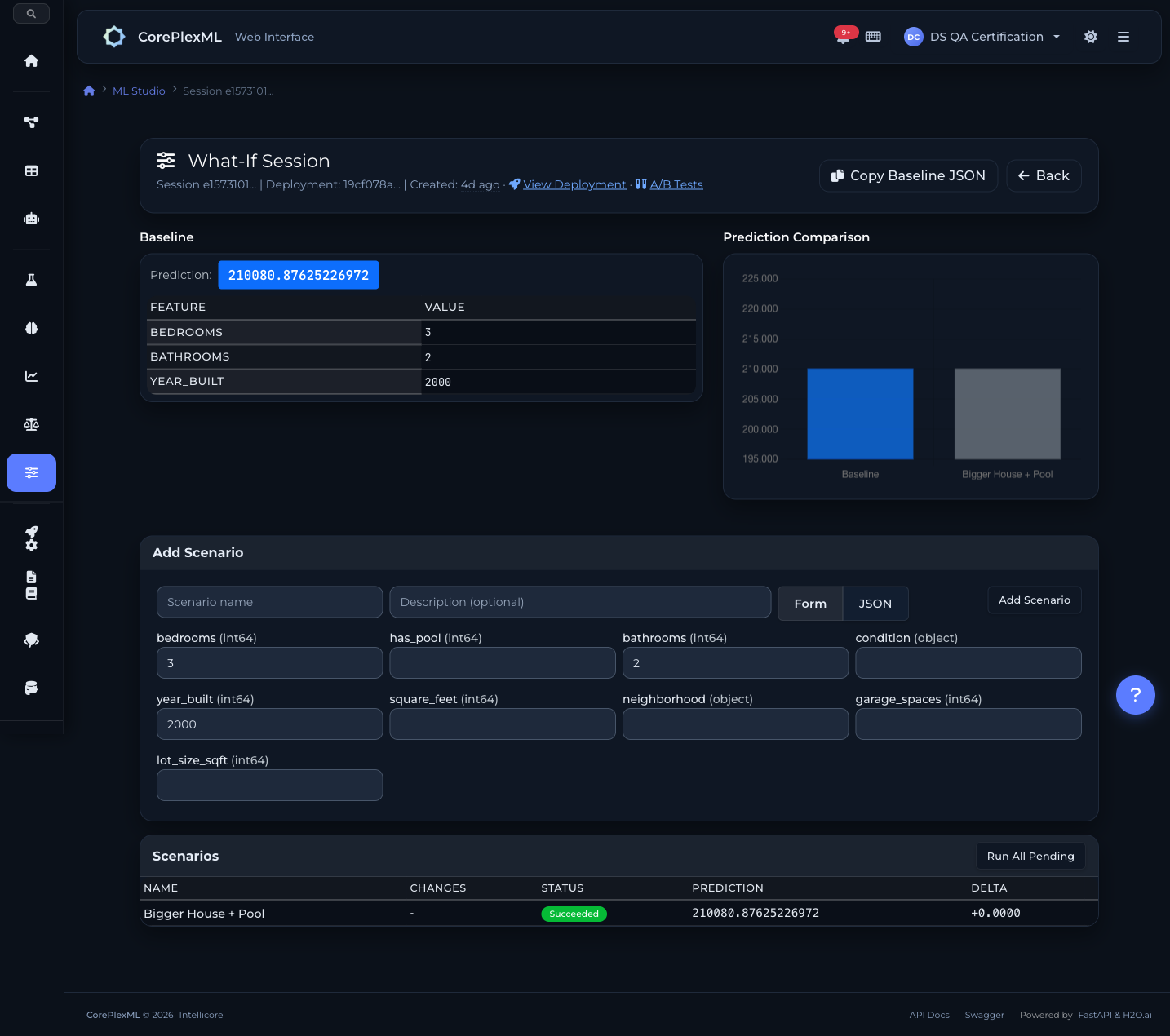

What-If Analysis

Explora el comportamiento del modelo interactivamente. Cambia features de entrada, crea escenarios y compara predicciones con explicaciones SHAP — sin necesidad de código.

Selecciona un modelo desplegado y proporciona valores de entrada baseline. El sistema genera automáticamente un formulario de entrada a partir del esquema de tu dataset.

Modifica valores de features para crear escenarios alternativos. Cambia edad, ingresos, puntuación de crédito — cualquier entrada — y nombra cada escenario para fácil referencia.

Ejecuta todos los escenarios contra el modelo desplegado. Ve predicciones lado a lado con valores delta que muestran exactamente cómo cada cambio impacta el resultado.

Las contribuciones SHAP revelan qué features impulsan cada predicción. Ve el impacto por feature con indicadores direccionales para explicaciones amigables al negocio.

Soporta todos los tipos de predicción

Salidas numéricas con contribuciones SHAP

Probabilidad + etiqueta de clase con explicaciones

Todas las probabilidades de clase + clase predicha

Análisis de escenarios What-If

Comparación de escenarios con contribuciones SHAP

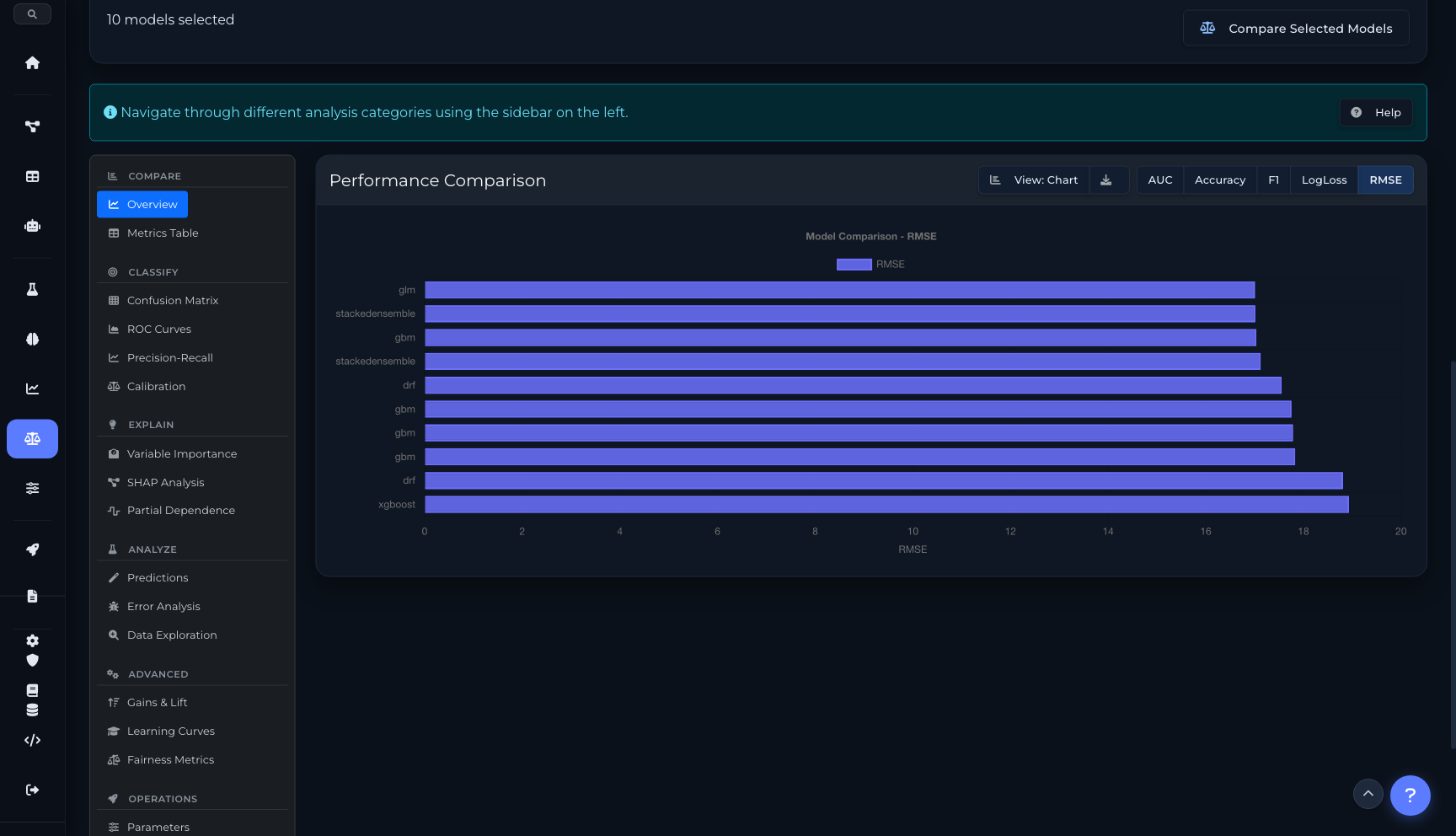

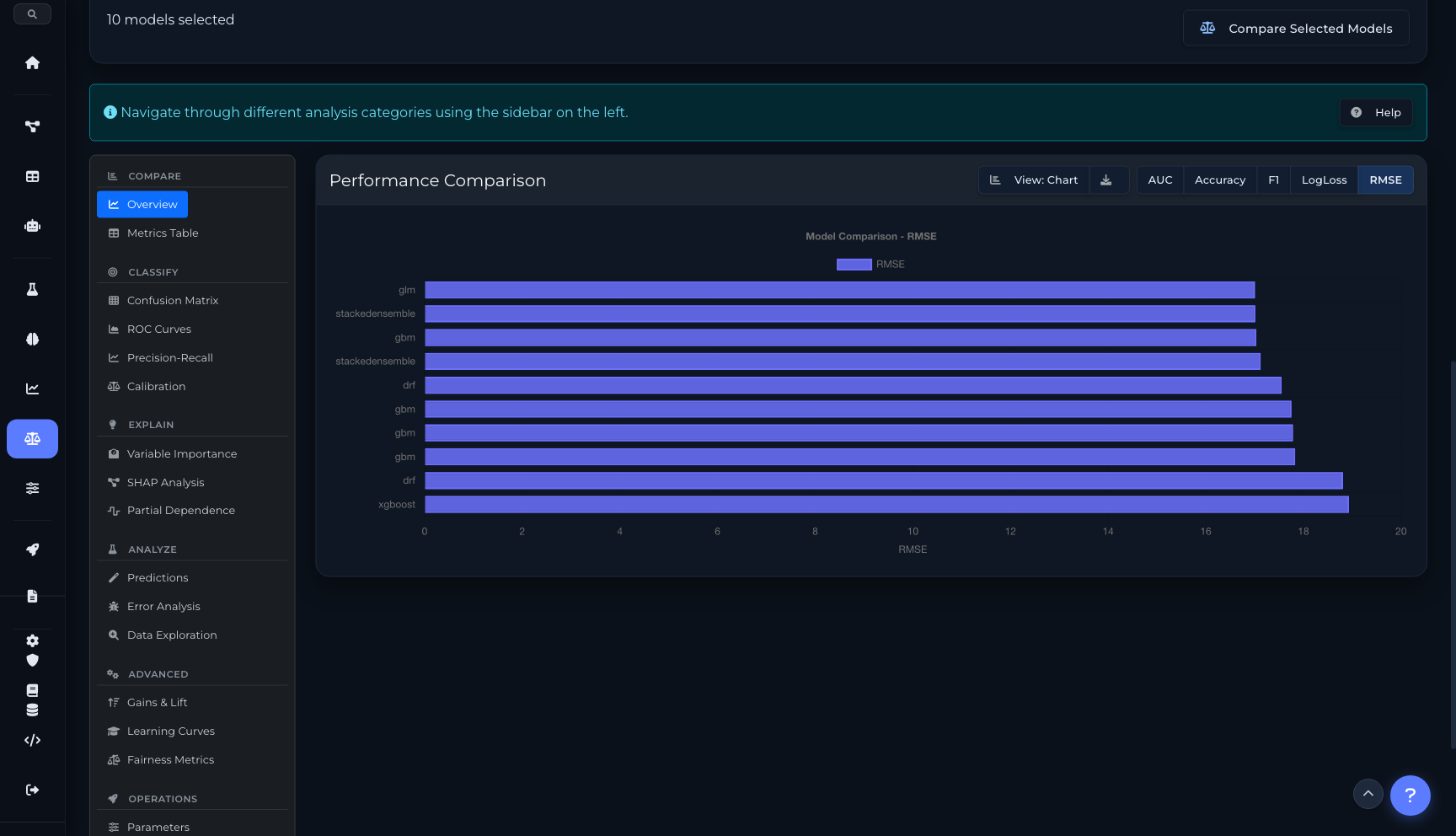

Espacio de Comparación de Modelos

Un espacio de diagnóstico completo con 20 pestañas de análisis en 6 categorías. Selecciona modelos de cualquier experimento, compáralos simultáneamente y toma decisiones basadas en datos sobre qué modelo desplegar.

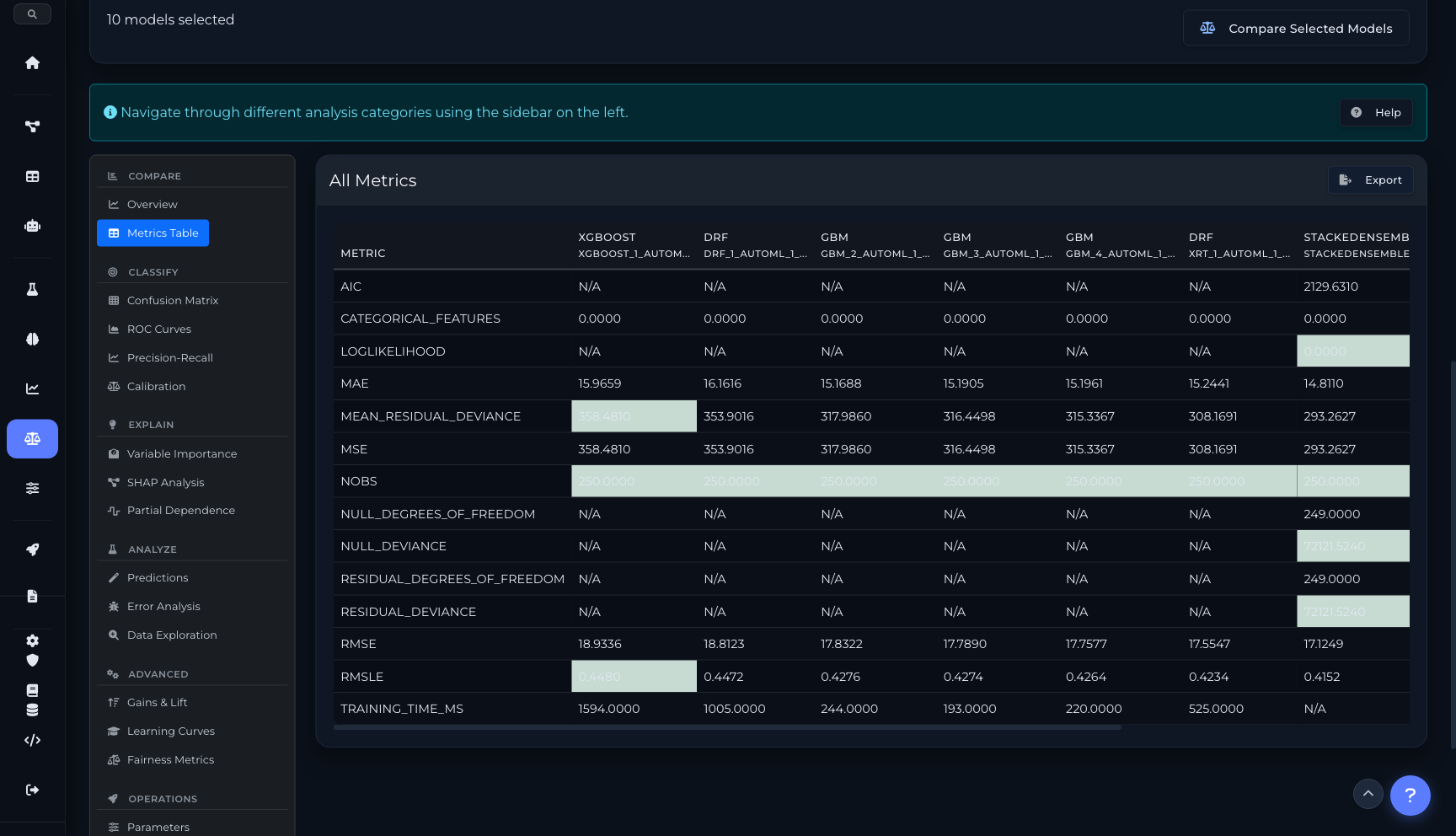

Comparar

2 tabsGráfico de rendimiento comparando todos los modelos en AUC, Accuracy, F1, LogLoss o RMSE. Alterna entre vista de gráfico y tabla.

Matriz completa de métricas — MAE, MSE, RMSE, RMSLE, AIC, tiempo de entrenamiento y más — de todos los modelos en una tabla exportable.

Clasificar

4 tabsMatrices de confusión lado a lado para cada modelo. Visualiza verdaderos/falsos positivos y negativos de un vistazo.

Curvas ROC (Receiver Operating Characteristic) superpuestas para comparación directa. Valores AUC anotados por modelo.

Curvas PR que muestran el trade-off entre precisión y recall para cada modelo, crítico para datasets desbalanceados.

Gráficos de calibración que muestran qué tan bien las probabilidades predichas coinciden con los resultados reales. Identifica modelos sobreconfiados o subconfiados.

Explicar

3 tabsGráfico de barras agrupadas mostrando rankings de importancia de features en todos los modelos simultáneamente. Detecta qué features importan más.

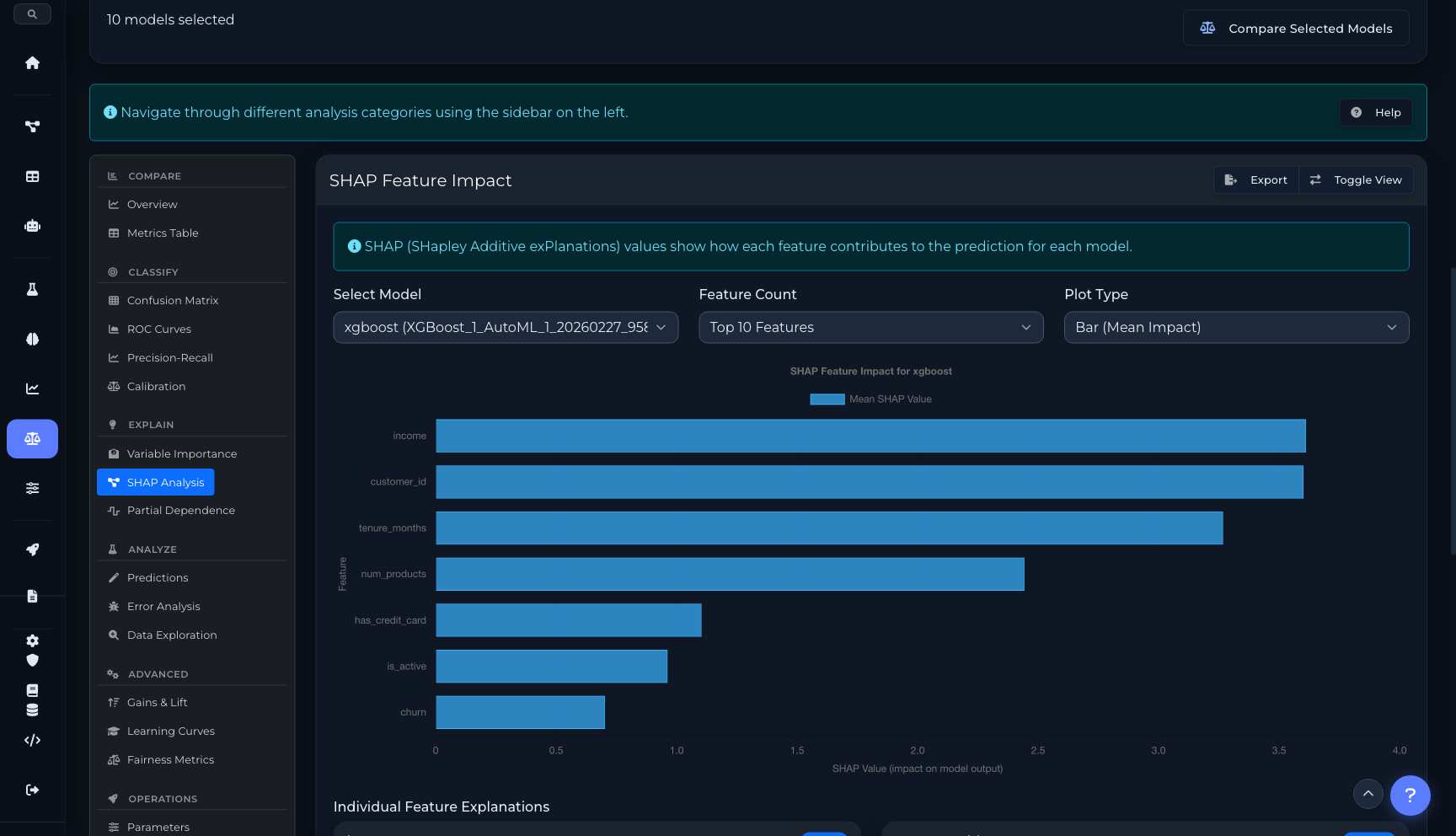

Impacto SHAP de features con tipos de gráfico bar, violin y beeswarm. Valores SHAP por modelo con explicaciones individuales de features.

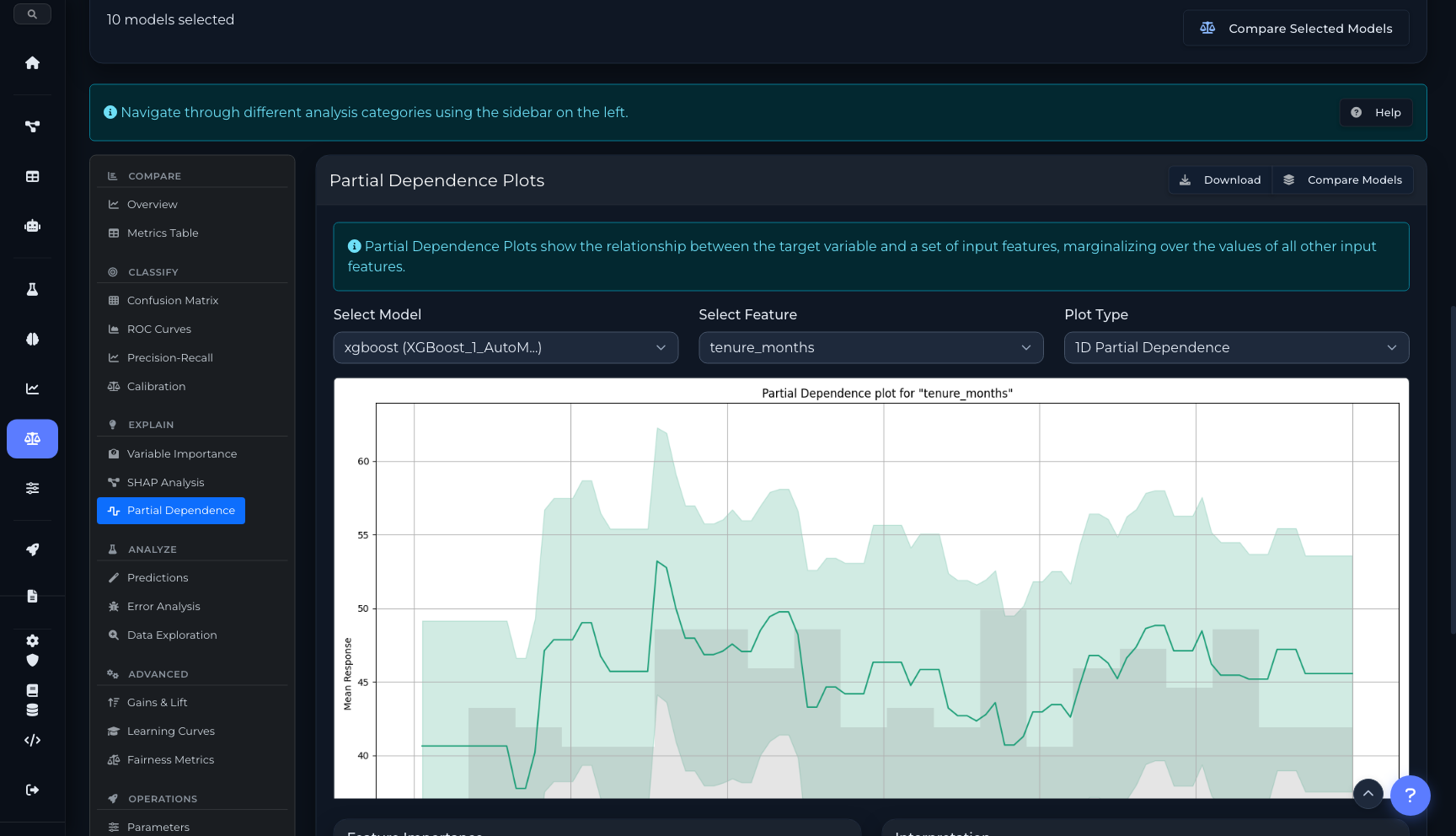

PDP 1D, heatmaps de interacción 2D y gráficos ICE. Ve cómo cada feature influye en las predicciones a lo largo de su rango.

Analizar

3 tabsGráficos de dispersión real vs predicho y análisis de residuos. Identifica patrones en los errores de predicción.

Distribución de errores por rangos de valores de features. Encuentra dónde tu modelo tiene dificultades y por qué.

Histogramas de distribución de features y análisis de correlación. Comprende los datos con los que se entrenaron tus modelos.

Avanzado

3 tabsGráficos de ganancias acumuladas y lift para evaluar la efectividad del modelo en diferentes percentiles de población.

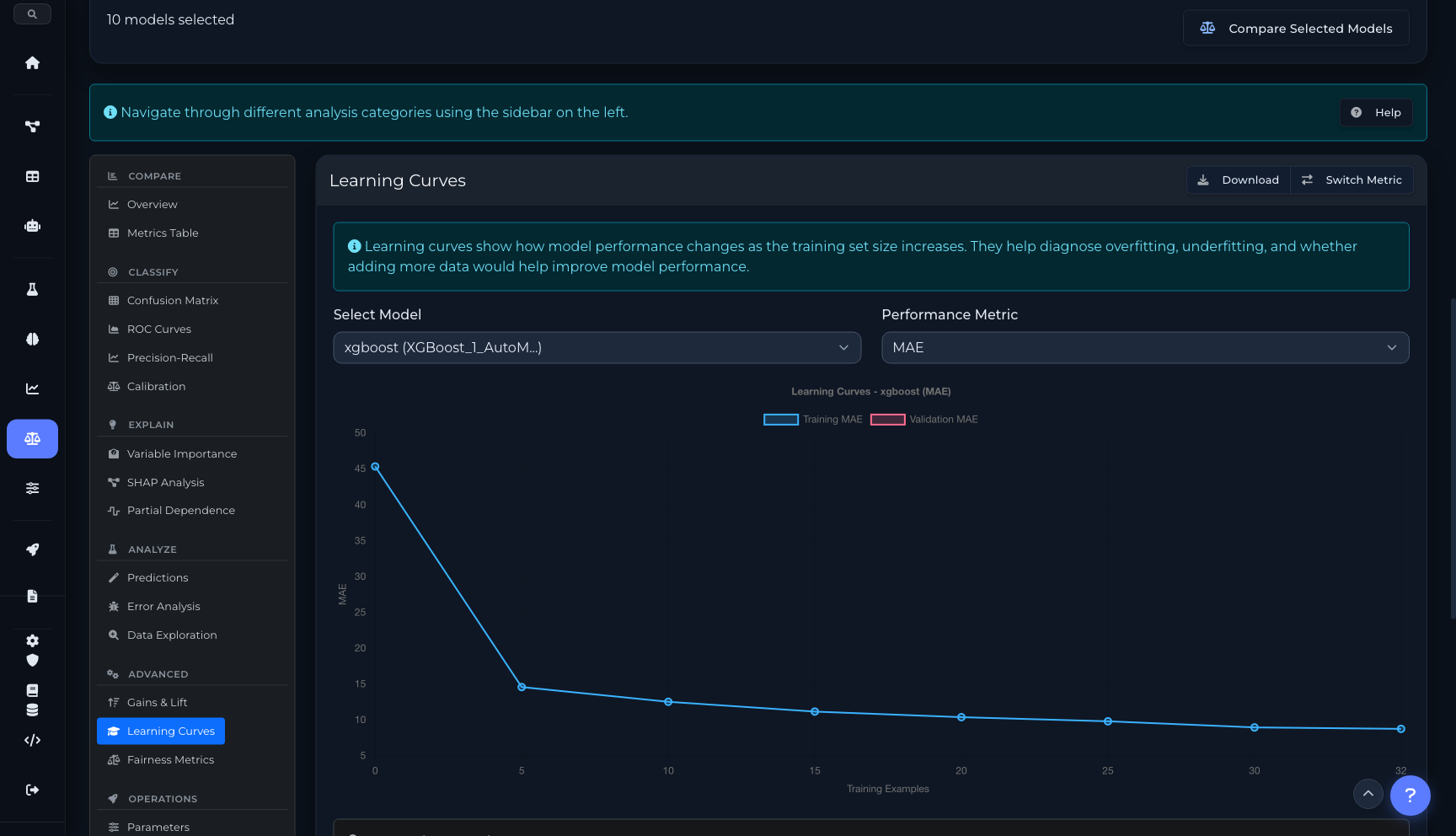

Rendimiento de entrenamiento vs validación a medida que aumenta el tamaño de datos. Diagnostica overfitting, underfitting y suficiencia de datos.

Métricas de paridad demográfica, igualdad de oportunidades e impacto desigual. Audita modelos en busca de sesgo entre grupos protegidos.

Operaciones

4 tabsTabla completa de comparación de hiperparámetros. Compara configuraciones entre modelos para entender qué impulsa las diferencias de rendimiento.

Construye ensembles ponderados personalizados a partir de modelos seleccionados. Optimiza pesos y evalúa el modelo combinado.

Métricas de latencia, throughput y uso de recursos para modelos desplegados. Compara características operacionales.

Linaje completo del experimento — versión del dataset, configuración de entrenamiento, tiempo de ejecución y evolución de métricas a lo largo del tiempo.

Espacio de Comparación de Modelos

Gráfico de comparación de rendimiento (10 modelos, 5 métricas)

Tabla de métricas completa con exportación

Comparación de importancia de variables entre modelos

Análisis SHAP con impacto de features y explicaciones LIME

Dependencia parcial con modos 1D, mapa de calor 2D e ICE

Curvas de aprendizaje con diagnóstico de overfitting/underfitting

Análisis en todas las industrias

Desde evaluación de préstamos hasta calidad de manufactura — usa escenarios What-If y comparación de modelos para tomar mejores decisiones.

Suscripción de Préstamos

Usa What-If para probar cómo los cambios en ingresos o puntuación de crédito afectan la aprobación. Usa Comparar para seleccionar el mejor modelo entre decenas de candidatos con auditoría de equidad.

Pricing de Seguros

Compara candidatos de modelos en gráficos de calibración para asegurar predicciones de primas precisas. Ejecuta escenarios What-If para diferentes perfiles de riesgo.

Churn de Clientes

Compara modelos en curvas ROC y precisión-recall para datos de churn desbalanceados. Usa SHAP para explicar qué factores impulsan las predicciones de churn.

Resultados en Salud

Ejecuta métricas de equidad en grupos demográficos. Usa gráficos PDP para entender cómo la dosis de tratamiento afecta los resultados predichos.

Detección de Fraude

Compara el rendimiento del modelo en diferentes umbrales usando gráficos de ganancias/lift. Pruebas What-If para transacciones en casos extremos.

Calidad en Manufactura

Usa curvas de aprendizaje para determinar si más datos de entrenamiento ayudarían. Construye ensembles optimizados a partir de múltiples tipos de modelos.

Automatiza con el SDK

Tanto las sesiones What-If como los datos de comparación de modelos están disponibles mediante programación a través del Python SDK.

from coreplexml import CorePlexMLClient

client = CorePlexMLClient(

base_url="https://api.coreplexml.io",

api_key="sk_your_api_key"

)

# Create a What-If session

session = client.studio.create_session(

project_id="proj_abc",

deployment_id="dep_fraud_v2",

baseline_input={

"amount": 150, "merchant": "grocery",

"hour": 14, "country": "US"

}

)

print(f"Baseline prediction: {session['baseline']['prediction']}")

# Add high-risk scenario

scenario = client.studio.create_scenario(

session_id=session["id"],

name="High-risk transaction",

changes={"amount": 9500, "hour": 3, "country": "NG"}

)

# Run and compare

result = client.studio.run_scenario(scenario["id"])

print(f"Scenario: {result['prediction']} (delta: {result['delta']:+.2%})")# Model Comparison API

models = client.models.list(

project_id="proj_abc",

experiment_id="exp_t1",

limit=10

)

# Get metrics for comparison

for model in models["items"]:

metrics = model["metrics"]

print(f"{model['algorithm']}: "

f"RMSE={metrics.get('rmse', 'N/A')}, "

f"MAE={metrics.get('mae', 'N/A')}")

# Get SHAP values for a model

shap = client.models.get_shap(

model_id="mod_xgb_v2",

feature_count=10

)

for feat in shap["features"]:

print(f" {feat['name']}: {feat['mean_impact']:.4f}")

# Get variable importance comparison

varimp = client.models.get_variable_importance(

model_id="mod_xgb_v2"

)

# Get partial dependence plot data

pdp = client.models.get_pdp(

model_id="mod_xgb_v2",

feature="tenure_months",

nbins=20

)API de ML Studio

Endpoints para sesiones What-If, gestión de escenarios, métricas de modelos, análisis SHAP, dependencia parcial y tablas de clasificación de experimentos.

/api/studio/sessionsCrear una sesión de análisis What-If con entrada baseline

/api/studio/deployments/{id}/schemaObtener esquema de entrada para generación automática de formularios

/api/studio/sessions/{id}/scenariosCrear un nuevo escenario con valores de features modificados

/api/studio/scenarios/{id}/runEjecutar escenario y obtener predicción con SHAP

/api/studio/sessions/{id}/compareComparar todos los escenarios lado a lado con deltas

/api/modelsListar modelos con filtros por proyecto, experimento y algoritmo

/api/models/{id}Obtener detalles del modelo, métricas e hiperparámetros

/api/models/{id}/variable-importanceObtener rankings de importancia de variables para un modelo

/api/models/{id}/shapObtener valores de impacto de features SHAP (barras, violin, beeswarm)

/api/models/{id}/pdpObtener datos de gráfico de dependencia parcial (1D, 2D, ICE)

/api/models/{id}/contributionsObtener contribuciones SHAP por predicción

/api/experiments/{id}/leaderboardObtener tabla de clasificación de modelos con métricas

¿Listo para empezar?

Empieza a construir con CorePlexML hoy. Nivel gratuito disponible — no se requiere tarjeta de crédito.